百度世界2020飞桨再迎更新 属于中国的智能时代操作系统已趋完善

云栖网:9月15日,以“万物智能”为主题的百度世界2020大会于线上召开,作为人工智能领域的年度盛会,大会吸引了众多行业专家、技术大咖、开发者及科技爱好者的关注。现场,百度CTO王海峰宣布百度自研的飞桨深度学习平台迎来全新升级,向观众揭示了核心技术自主可控、开源开放的重要价值。

在当天下午的百度大脑分论坛,百度深度学习技术平台部高级总监马艳军从技术层面出发,用“动静统一、软硬融合”形容飞桨的此次更新:硬件上,飞桨目前已适配22种芯片型号,覆盖15家硬件厂商,对国产硬件的支持超过TensorFlow和PyTorch;软件上,动态图功能升级实现了动静态的结合,让用户更容易开发模型;全面升级的API体系,则对于开发者更加友好。目前,飞桨可以与华为等硬件进行深度配合,让AI应用收获更强劲的效果,加速人工智能技术的进一步普及。

(百度深度学习技术平台部高级总监马艳军)

深度学习框架与芯片硬件绑定助推AI应用体验“坐火箭”

深度学习框架需要和芯片做深度对接适配才能实现高性能,并优化AI应用的体验,这点已经成为业界的常识。因此,深度学习框架对硬件厂商的适配程度,决定了它的性能与实用程度。

而飞桨在这一点上已走在行业前列。据马艳军介绍,飞桨目前已可适配22种芯片型号,覆盖Intel、英伟达、华为、联发科、瑞芯微、寒武纪等15家硬件厂商,且对国产硬件的支持已经超过TensorFlow和PyTorch等国际主流框架。飞桨形成的繁荣硬件生态既在百度内部为智慧交通、基础架构提供了更高性价比的硬件选择,对外也助力海淀城市大脑、长城服务器等多个项目落地。

与华为的合作正是其中的一个典型。在去年七月的百度AI开发者大会上,百度飞桨与华为达成合作,双方在硬件底层打通,可以为端侧AI提供强劲算力,这一点在输入法应用上体现得特别明显:性能提升25%,内存节省22%,功耗降低50%,而且表现更加稳定,不会受到CPU的负载影响。

此外,在百度飞桨与华为的合作中,飞桨框架与华为HiAI能力开放平台全面对接,无缝整合HiAIFoundation的预测能力,飞桨开发者可以自动获得深度学习模型的硬件加速。同时得益于飞桨与达芬奇NPU的深度整合,可以让更多深度学习模型突破资源限制,带来更优秀的应用体验,并反过来驱动芯片平台性能提升与功能演进,达到双赢的局面。此外,英特尔高级工程师AndresRodrigus也在演讲中提到,英特尔至强处理器针对飞桨等深度学习框架做出优化后,在INT8与Bfloat16等AI任务上可以带来更高的计算性能与精度。

应用层再迎全面升级动静统一与API体系让深度学习更易用

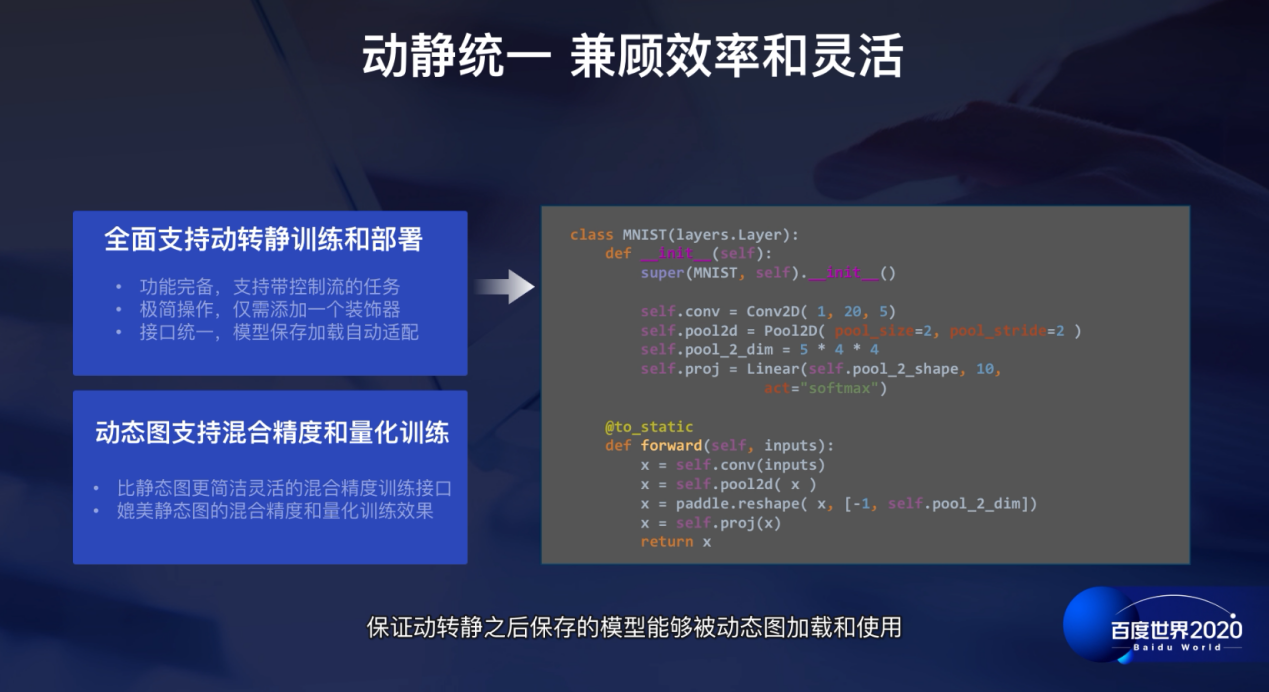

在现场,马艳军还带来飞桨开源框架的两大升级。首先是提供了更加完备和性能更优的动态图功能,以及更全面的动态图转静态图运行功能,在开发上实现“动静统一”。

据介绍,“动静统一”的优势是开发者可以兼顾效率与灵活。在动转静方面,飞桨现在已经支持完备的语法覆盖和带控制流的任务,且仅需一个装饰器就可以触发操作,统一的接口可以让模型保存加载实现自动适配。在动态图方面,飞桨提供了比静态图更简洁灵活的混合精度训练接口,并且实现媲美静态图的混合精度与量化训练效果。

以常见的ResNet训练为例,FP使用混合精度训练,比FP32方式速度提升了2.7倍。动态图还支持量化,在mobilenet,resnet等动态图模型的任务中,在保持精度不变的情况下,仅占FP32体积的1/4。开发者部署模型将会更加高效。

为了让深度学习应用落地更加简易,飞桨的API体系也全面升级。据介绍,飞桨形成了贴合用户使用习惯的全新API体系,包括包结构、API规范、共性问题优化等,面对用户更加友好;为了减少开发者的工作量,飞桨可以提供包含视觉、NLP等领域的模型和工具封装的高层API,以及最经典的模型结构;在兼容性上,飞桨可兼容1.X版本的API,并完善教程来引导用户操作。

马艳军还介绍,飞桨正在形成繁荣的开发者社区,第三方贡献增长了1080%。此外,飞桨还举办了大量的线上活动与实操课程,去年11月,百度飞桨团队推出了官方入门课程,以及相配套的教材书籍。今年,又推出了《飞桨PaddlePaddle深度学习实战》。这些课程与教材吸引了广大有志于人工智能领域的新同学,也一定程度上缓解了中国AI人才匮乏的困境。

在百度世界2020大会上,观众也注意到了人工智能时代AI操作系统、AI芯片等核心科技自主可控的重要性。而飞桨正是百度自主研发,目前国内唯一开源开放、技术领先、功能完备的产业级深度学习平台,也是中国人工智能健康发展的重要保障。

作为百度人工智能技术的集大成,升级到6.0的百度大脑正在承担着AI新型基础设施的角色,加速产业智能化升级。飞桨除了支撑百度内部业务,也在持续向产业输出深度学习技术,为中国提供自主可控、技术领先、便捷易用的人工智能时代系统底座。

行业

行业

热点

热点

栏目

栏目

产品

产品